什么是Apple Neural Engine神经引擎

您的 iPhone、iPad、Mac 和 Apple TV 使用称为 Apple 神经引擎 (ANE) 的专用神经处理单元,该单元比 CPU 或 GPU 更快、更节能。

ANE 使高级设备功能成为可能,例如自然语言处理和图像分析,而无需利用云或使用过多的电力。

让我们探索 ANE 的工作原理及其演变,包括它在 Apple 平台上所支持的推理和智能,以及开发者如何在第三方应用程序中使用它。

推荐:什么是脚本错误

什么是 Apple 神经引擎 (ANE)?

Apple Neural Engine 是一组高度专业化的计算核心的营销名称,这些核心经过优化,可在 Apple 设备上高效执行深度神经网络。 它可加速机器学习 (ML) 和人工智能 (AI) 算法,与主 CPU 或 GPU 相比具有巨大的速度、内存和功率优势。

ANE 是为什么最新的 iPhone、iPad、Mac 和 Apple TV 响应迅速并且在繁重的 ML 和 AI 计算期间不会变热的重要原因。 不幸的是,并非所有 Apple 设备都有 ANE——Apple Watch、基于 Intel 的 Mac 和 2016 年之前的设备都没有。

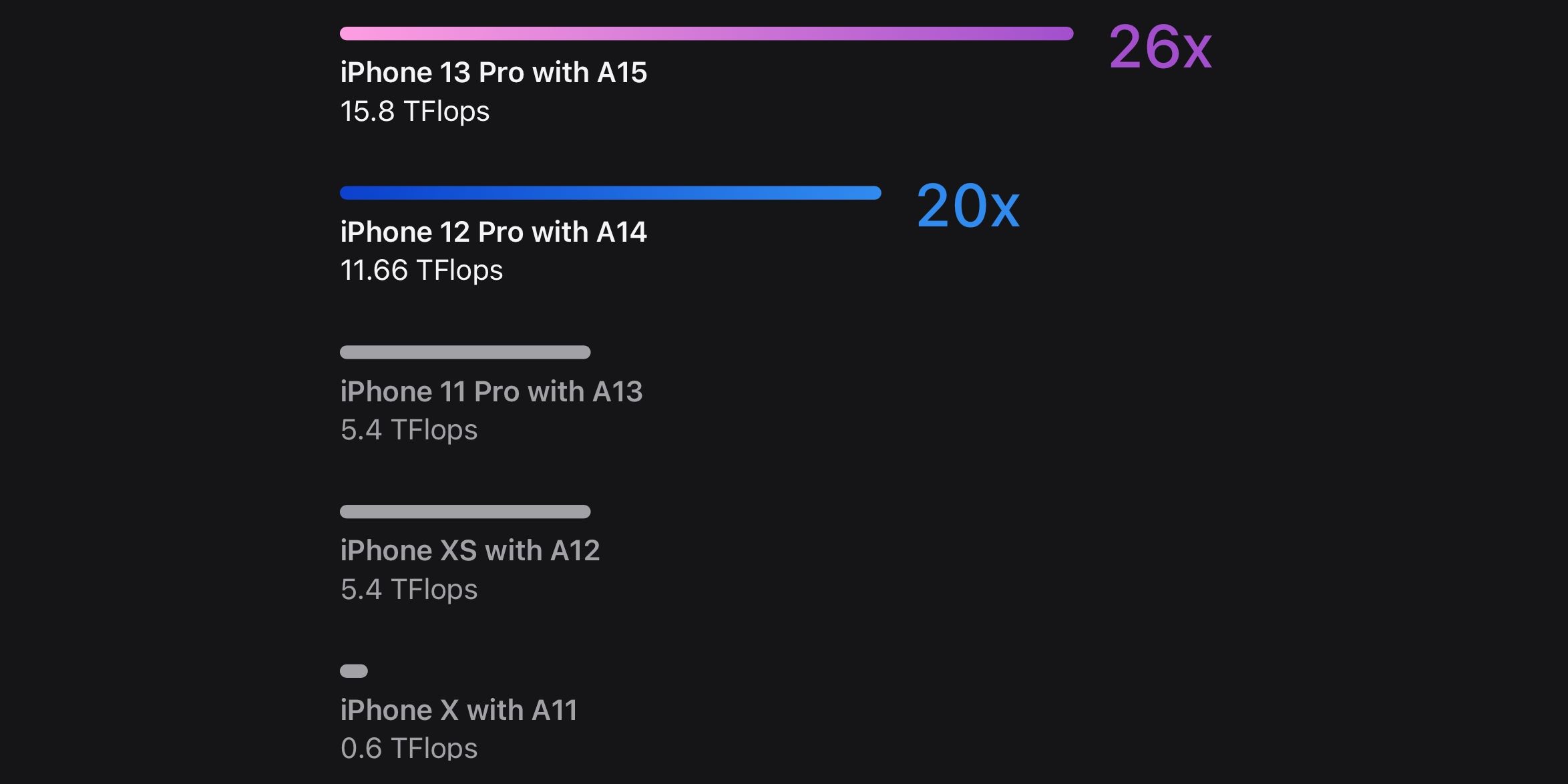

第一个 ANE 在 2017 年的 iPhone X 中首次出现在 Apple 的 A11 芯片中,功能强大到足以支持 Face ID 和 Animoji。 相比之下,A15 仿生芯片中最新的 ANE 比第一版快 26 倍。 如今,ANE 支持离线 Siri 等功能,开发人员可以使用它来运行之前训练过的 ML 模型,从而释放 CPU 和 GPU 以专注于更适合他们的任务。

Apple 的神经引擎如何工作?

ANE 提供优化的控制和算术逻辑,用于执行广泛的计算操作,如乘法和累加,常用于 ML 和 AI 算法,如图像分类、媒体分析、机器翻译等。

根据苹果公司名为“用于神经处理器的多模式平面引擎”的专利,ANE 由多个神经引擎核心和一个或多个多模式平面电路组成。

该设计针对并行计算进行了优化,其中必须同时执行许多操作,例如以数万亿次迭代运行的矩阵乘法。

为了加快 AI 算法的推理速度,ANE 使用了预测模型。 此外,ANE 有自己的缓存并且只支持几种数据类型,这有助于最大限度地提高性能。

由 ANE 提供支持的 AI 功能

以下是您可能熟悉的一些 ANE 使之成为可能的设备上功能。

- 自然语言处理:更快、更可靠的听写和 Siri 语音识别; 改进了翻译应用程序和整个系统中的自然语言学习; 照片、相机和其他 iPhone 应用程序中的即时文本翻译。

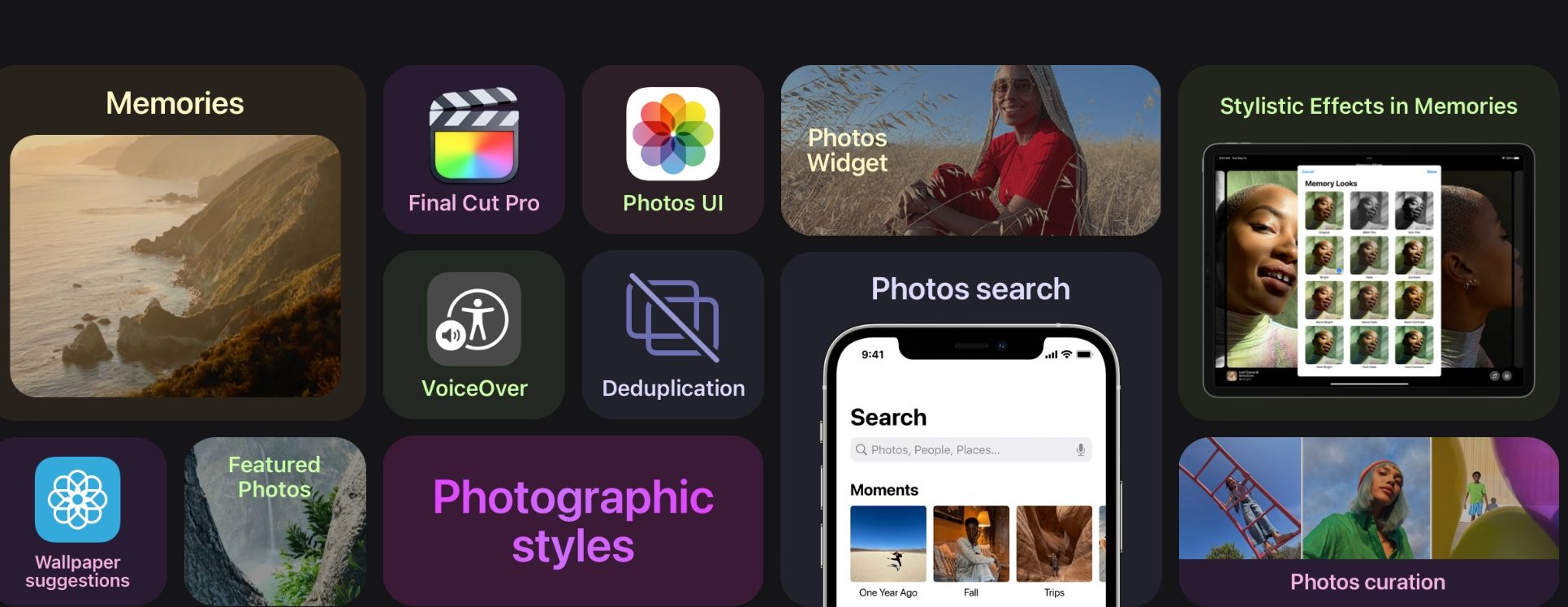

- 计算机视觉:使用照片应用程序或 Spotlight 搜索在地标、宠物、植物、书籍和花卉等图像中查找对象; 在 Safari、Mail 和 Messages 等地方使用 Visual Look Up 获取有关已识别对象的附加信息。

- 增强现实:AR 应用程序中的人物遮挡和运动跟踪。

- 视频分析:在 Final Cut Pro 等应用程序中检测视频中的人脸和物体。

- 相机效果:使用 Center Stage 自动裁剪; FaceTime 视频通话期间的背景模糊。

- 游戏:3D 视频游戏中的逼真效果。

- 实时文本:在相机和照片中提供光学字符识别 (OCR),让您可以轻松地从图像中复制手写或文字,例如 Wi-Fi 密码或地址。

- 计算摄影:Deep Fusion 分析像素以实现更好的降噪效果、更大的动态范围以及改进的自动曝光和白平衡,并在适当的时候利用智能 HDR; 浅景深摄影,包括拍摄夜间模式人像; 使用深度控制调整背景模糊程度。

- 花絮: ANE 还用于相机应用程序中的摄影风格、照片中的记忆管理和风格效果、墙纸建议等个性化推荐、VoiceOver 图像字幕、在照片中查找图像重复等。

上面提到的一些功能,如图像识别,在没有 ANE 的情况下也能运行,但运行速度会慢得多,并且会耗费设备的电池电量。

Apple 神经引擎简史:从 iPhone X 到 M2 Mac

2017 年,Apple 在 iPhone X 的 A11 芯片中以两个专用内核的形式部署了其首个 ANE。 按照今天的标准,它相对较慢,每秒只有 6000 亿次操作。

第二代 ANE 于 2018 年出现在 A12 芯片内部,核心数量是其四倍。 该 ANE 的额定速度为每秒 5 万亿次运算,速度几乎是其前身的 9 倍,耗电量仅为其前身的十分之一。

2019 年的 A13 芯片具有相同的八核 ANE,但运行速度提高了五分之一,同时功耗降低了 15%,这是台积电增强型 7 纳米半导体节点的产物。 台积电(台积电)制造苹果设计的芯片。

苹果神经引擎的演变

| 苹果硅 | 半导体工艺节点 | 发射日期 | ANE 核心 | 每秒操作数 | 补充笔记 |

|---|---|---|---|---|---|

| A11仿生 | 10nm 台积电FinFET | 2017年 | 2个 | 6000亿 | Apple 的第一个 ANE |

| A12仿生 | 7nm 台积电FinFET | 2018 | 8个 | 5万亿 | 比 A11 快 9 倍,功耗降低 90% |

| A13仿生 | 7nm 台积电N7P | 2019 | 8个 | 6万亿 | 比A12快20%,功耗低15% |

| A14仿生 | 5nm 台积电N5 | 2020 | 16 | 11万亿 | 比 A13 快近 2 倍 |

| A15仿生 | 5nm 台积电N5P | 2021年 | 16 | 15.8万亿 | 比 A14 快 40% |

| A16仿生 | 5nm台积电N4 | 2022年 | 16 | 17万亿 | 比A15快8%,电源效率更好 |

| M1 | 5nm 台积电N5 | 2020 | 16 | 11万亿 | 与 A14 仿生相同的 ANE |

| M1专业版 | 5nm 台积电N5 | 2021年 | 16 | 11万亿 | 与 A14 仿生相同的 ANE |

| M1最大 | 5nm 台积电N5 | 2021年 | 16 | 11万亿 | 与 A14 仿生相同的 ANE |

| M1 极致 | 5nm 台积电N5 | 2022年 | 32 | 22万亿 | 比 M1/M1 Pro/M1 Max 快 2 倍 |

| M2 | 5nm 台积电N5P | 2022年 | 16 | 15.8万亿 | 比 M1 快 40% |

| M2专业版 | 5nm 台积电N5P | 2023年 | 16 | 15.8万亿 | 与 M2 相同的 ANE |

| M2最大 | 5nm 台积电N5P | 2023年 | 16 | 15.8万亿 | 与 M2 相同的 ANE |

次年,Apple A14 通过将 ANE 核心数量从 8 个增加到 16 个,将 ANE 性能几乎翻了一番,达到每秒 11 万亿次运算。2021 年,A15 Bionic 受益于台积电的第二代 5nm 工艺,进一步提升了 ANE在不添加更多内核的情况下,性能达到每秒 15.8 万亿次操作。

首款 Mac 绑定的 M1、M1 Pro 和 M1 Max 芯片具有与 A14 相同的 ANE,首次将先进的硬件加速 ML 和 AI 引入 macOS 平台。

2022 年,M1 Ultra 使用 Apple 名为 UltraFusion 的定制互连将两个 M1 Max 芯片组合在一个封装中。 凭借两倍的 ANE 内核 (32),M1 Ultra 将 ANE 性能提高了一倍,达到每秒 22 万亿次运算。

2022 年的 Apple A16 采用台积电增强型 N4 节点制造,与 A15 的 ANE 相比,ANE 性能提高了约 8%(每秒 17 万亿次运算)。

首批支持 ANE 的 iPad 是第五代 iPad mini (2019)、第三代 iPad Air (2019) 和第八代 iPad (2020)。 此后发布的所有 iPad 都有 ANE。

开发人员如何在应用程序中使用 ANE?

许多第三方应用程序使用 ANE 来实现否则不可行的功能。 比如图像编辑器Pixelmator Pro,就提供了ML Super Resolution、ML Enhance等工具。 在 djay Pro 中,ANE 从录音中分离节拍、乐器和人声轨道。

但是,第三方开发人员无法获得对 ANE 的低级别访问权限。 相反,所有 ANE 调用都必须通过 Apple 的机器学习软件框架 Core ML。 借助 Core ML,开发人员可以直接在设备上构建、训练和运行他们的 ML 模型。 然后使用这样的模型根据新的输入数据进行预测。

根据 Apple 网站上的 Core ML 概述,“一旦模型出现在用户的设备上,您就可以使用 Core ML 在设备上使用该用户的数据重新训练或微调它”。

为了加速 ML 和 AI 算法,Core ML 不仅利用 ANE,还利用 CPU 和 GPU。 这允许 Core ML 即使没有可用的 ANE 也能运行模型。 但是有了 ANE,Core ML 会运行得更快,并且电池不会很快耗尽。

如果没有 ANE,许多 Apple 功能将无法使用

如果没有 AI 和 ML 算法的快速处理以及 ANE 带来的最小内存占用和功耗,许多设备上的功能将无法实现。 Apple 的神奇之处在于拥有一个专用的协处理器,用于在设备上私密地运行神经网络,而不是将这些任务卸载到云端的服务器上。

借助 ANE,Apple 和开发者都可以实施深度神经网络,并从机器翻译、对象检测、图像分类等各种预测模型的加速机器学习中获益。